Mục lục

- 🔍 Transformer là gì?

- 🧩 Các thành phần chính của Transformer

- 💡 Tại sao Transformer lại “thần thánh”?

- 🚀 Kết luận

Một trong những phát minh quan trọng nhất của lĩnh vực AI trong những năm gần đây đó là kiến trúc Transformer. Nếu bạn từng tự hỏi ChatGPT hoạt động như thế nào, bài viết này sẽ giải thích cho bạn!

🔍 Transformer là gì?

Hình 1: Minh hoạ kiến trúc Transformer như bộ não xử lý tín hiệu qua mạng lưới tế bào thần kinh

Transformer là kiến trúc nền tảng đằng sau các mô hình ngôn ngữ lớn (LLM) như ChatGPT, Bard và Google Translate.

Hãy tưởng tượng Transformer như một đội phiên dịch siêu đẳng. Khi bạn gõ câu “I love AI”, đội này không chỉ dịch từng từ đơn lẻ mà còn phân tích toàn bộ ngữ cảnh, xác định những từ quan trọng và hiểu mối liên hệ giữa chúng.

Điều này xảy ra nhờ một cơ chế đặc biệt gọi là “tập trung” (attention) – tương tự như cách bạn đánh dấu những ý chính khi đọc sách!

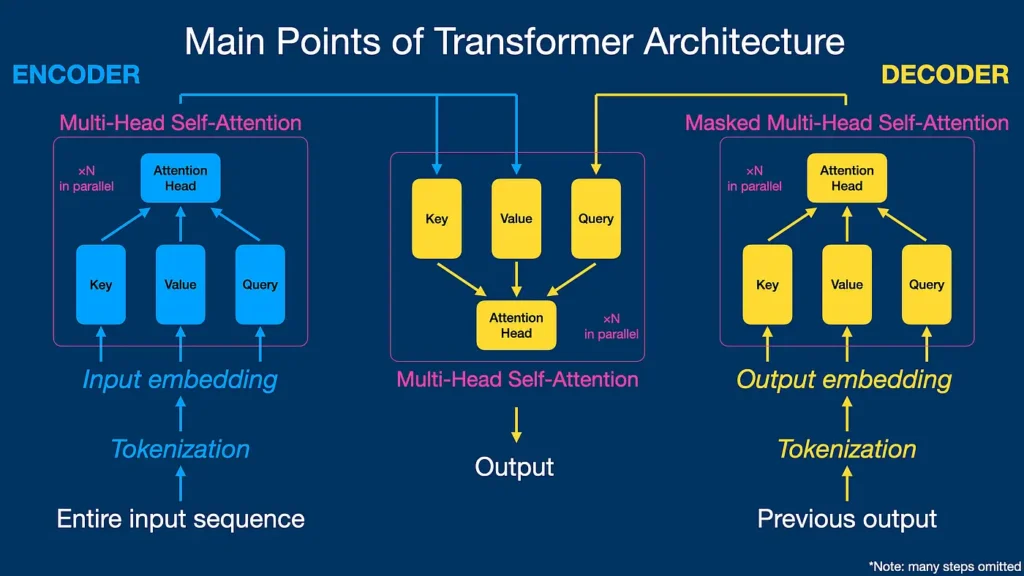

🧩 Các thành phần chính của Transformer

Hình 2: Các thành phần chính của Transformer

📊 Input Embedding: Biến từ thành “mật mã số”

Máy tính không hiểu ngôn ngữ tự nhiên như chúng ta. Chúng chỉ hiểu số. Vì vậy, bước đầu tiên là biến mỗi từ thành một vector số (dãy số đặc trưng):

- “Chó” → [0.2, 1.5, -0.7]

- “Mèo” → [0.8, -0.3, 1.1]

Quá trình này giống như việc dịch từ sang ngôn ngữ bí mật mà chỉ máy tính hiểu được!

Điều thú vị là: những từ có ý nghĩa tương tự sẽ có vector gần giống nhau. Ví dụ, “chó” và “cún” sẽ có vector gần nhau hơn so với “chó” và “máy tính”.

📍 Positional Encoding: Thêm “tọa độ GPS” cho từng từ

Trong tiếng Việt, thứ tự từ rất quan trọng. “Tôi ăn cơm” khác hoàn toàn với “Cơm ăn tôi”, đúng không?

Transformer giải quyết vấn đề này bằng cách thêm thông tin vị trí vào vector của mỗi từ:

- “Tôi” (vị trí 1) → [0.2, 1.5, -0.7, 0.1]

- “Ăn” (vị trí 2) → [0.8, -0.3, 1.1, 0.5]

Điều này giống như việc dán nhãn số thứ tự cho từng mảnh ghép Lego, để khi lắp ráp, chúng sẽ theo đúng trình tự!

🔦 Attention Mechanism: “Đèn spotlight” chiếu vào từ quan trọng

Đây là trái tim của Transformer! Cơ chế attention tính toán độ liên quan giữa mỗi từ trong câu với tất cả các từ khác.

Ví dụ trong câu “Tôi thích AI vì nó thông minh”:

- Khi xử lý từ “nó”, Transformer sẽ xác định “nó” liên quan mạnh đến “AI”

- Khi xử lý “thông minh”, nó sẽ liên kết với “AI” và “nó”

Cơ chế này tạo ra một bản đồ tập trung (attention map) – tương tự như khi đọc truyện trinh thám, bạn đánh dấu manh mối quan trọng và bỏ qua chi tiết thừa!

⚙️ Feed Forward Neural Network: “Xử lý hậu trường”

Sau khi có thông tin từ attention, dữ liệu được đưa qua một mạng neural đơn giản để tinh chỉnh và chuẩn bị cho bước tiếp theo.

Đây giống như đầu bếp nêm nếm gia vị sau khi đã chọn nguyên liệu chính. Hoặc như một người biên tập viên, chỉnh sửa bài viết sau khi đã có ý tưởng chính!

💡 Tại sao Transformer lại “thần thánh”?

⚡ Xử lý song song

Khác với các mô hình trước đó (như RNN/LSTM) phải xử lý từng từ một theo thứ tự, Transformer có thể xử lý cả câu cùng lúc.

Điều này giống như sự khác biệt giữa:

- Dàn nhạc chơi hòa âm (Transformer) – tất cả nhạc công cùng chơi

- Độc tấu từng nhạc cụ (RNN) – lần lượt từng người một

Kết quả? Transformer nhanh hơn đáng kể!

🔍 Hiểu ngữ cảnh sâu

Nhờ cơ chế attention, Transformer nắm bắt được mối quan hệ giữa các từ dù chúng cách xa nhau trong câu.

Ví dụ trong câu: “Cô ấy mua chiếc váy đỏ tại cửa hàng thời trang ở trung tâm thương mại vào tuần trước, nhưng đã trả lại vì nó quá chật“

→ “Quá chật” liên kết với “váy đỏ” dù cách xa nhiều từ

Giống như một thám tử giỏi kết nối các manh mối ở nhiều trang sách khác nhau!

🌈 Linh hoạt

Transformer có thể được áp dụng cho nhiều nhiệm vụ khác nhau:

- Dịch máy

- Sinh văn bản

- Phân tích cảm xúc

- Trả lời câu hỏi

- Tóm tắt văn bản

Giống như một con dao đa năng trong thế giới AI!

🚀 Kết luận

Transformer thực sự là “siêu anh hùng” của AI hiện đại với những ưu điểm vượt trội:

- Tốc độ cao: Xử lý song song

- Độ chính xác: Hiểu ngữ cảnh sâu

- Tính linh hoạt: Áp dụng được cho nhiều bài toán

Tóm tắt nhanh cách Transformer hoạt động:

- Input Embedding → Từ thành số (như dịch sang mật mã)

- Positional Encoding → Thêm vị trí (như đánh số trang sách)

- Attention → Tìm mối liên hệ (như vẽ đường nối giữa các ý tưởng)

- Feed Forward → Tinh chỉnh (như lọc nước sau khi thu thập)

Hy vọng bài viết này giúp bạn hiểu rõ hơn về công nghệ đằng sau những công cụ AI mà chúng ta đang sử dụng hàng ngày. Bạn có thắc mắc gì về Transformer không? Hãy để lại bình luận bên dưới nhé!

Chú thích: Bài viết này chỉ giới thiệu Transformer ở mức cơ bản, dễ hiểu. Để tìm hiểu sâu hơn về các công thức toán học và chi tiết kỹ thuật, bạn có thể tham khảo bài báo gốc “Attention Is All You Need” của Google.